Texas, Estados Unidos. Dan Stanzione, director ejecutivo del Centro de Cómputo Avanzado de Texas (TACC), perteneciente a la Universidad de Texas en Austin, advirtió sobre la existencia de una burbuja de inversión en Inteligencia Artificial, aunque subraya que la tecnología generará beneficios significativos a largo plazo.

Para el directivo e investigador del TACC, la operación de OpenAI es un ejemplo claro de la situación en el mercado. Mientras que se estima que la compañía genera ingresos por alrededor de 12,000 millones de dólares al año (estimaciones recientes apuntan a 25,000 mdd anualizados), se ha comprometido a invertir 1.3 billones durante los próximos cinco años. Para justificar esta inversión masiva, la empresa tendría que alcanzar ingresos por cientos de miles de millones de dólares.

Stanzione cuestionó “si el mercado global de IA generará 1 billón ó 3 billones anuales. Cualquiera de estas cifras representaría un éxito extraordinario, pero en uno de estos escenarios, la mitad de las empresas quebraría. O [el mercado] crece muy rápido, o va a dejar de expandirse en el próximo par de años”.

Además de la generación de ingresos, también cuestionó la eficiencia en la operación de las empresas de IA, considerando el costo de la energía, el mantenimiento de los equipos de cómputo y la renovación constante de los componentes.

Por su parte, David Schmidt, director senior de gestión de producto de servidores PowerEdge en Dell, desestimó que el ciclo de inversión actual en Centros de Datos se trate de una burbuja. Aunque admitió que “existe una demanda agresiva de IA”, apuntó que la inversión está más ligada a los procesos de renovación de infraestructura por parte del sector empresarial.

No obstante, consideró que después de haber construido más capacidad de Centros de Datos, la cuestión se centrará en si estos están siendo utilizados de forma correcta, si la economía de la IA se ha adaptado, o si incluso se requerirá más capacidad.

Demanda infinita, presupuestos finitos

Pese a los temores por una posible burbuja en infraestructura, los principales hiperescaladores en el mundo han afirmado que la demanda está superando incluso su capacidad de oferta de cómputo. De manera similar, en el sector científico Stanzione identifica que la demanda de cómputo es “prácticamente infinita”, pero está limitada por presupuestos gubernamentales.

Para Frontera, el supercomputador de TACC, se reciben solicitudes de 120 millones de horas de nodo anuales, pero sólo se pueden asignar 65 millones. El Centro cuenta con un proceso de revisión por pares para determinar qué proyectos reciben recursos, al considerar factores como el tipo de carga de trabajo, si es un proyecto financiado, o si proviene de la Fundación Nacional de Ciencias (NSF).

Aunque la mayoría de investigadores requieren acceso a las instalaciones más modernas, como es el caso de Frontera, otras supercomputadoras del campus, por ejemplo Stampede 2, aún pueden atender ciertos proyectos menos demandantes de cómputo. No obstante, algunos de estos equipos también pueden ser apagados ante los altos costos de energía.

Admitió que los presupuestos federales estadounidenses para ciencia están declinando ligeramente, limitando el crecimiento masivo. Sin embargo, inversiones significativas de otros países, particularmente China, podrían impulsar iniciativas de “IA soberana”, lo que requerirá el despliegue de infraestructura que garantice la seguridad de los datos.

Dentro de TACC

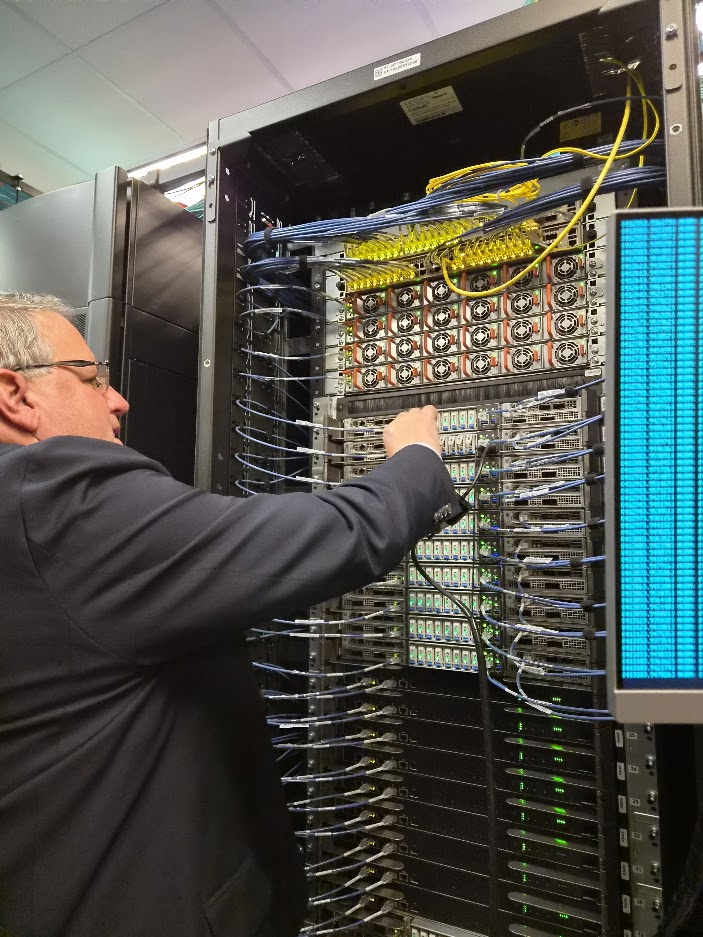

Frontera, lanzada en 2019 con una inversión de 60 millones de dólares aportados por la NSF, debutó como la quinta supercomputadora más rápida del mundo y la número uno entre el segmento universitario. El sistema fue construido por Dell EMC, equipada con procesadores Intel Xeon de segunda generación e interconexión Mellanox Infiniband.

El TACC está cerca de encender la supercomputadora Horizon este año, que contará con cerca de 4,000 GPUs Nvidia y un millón de núcleos de CPU, con lo que aportará 300 petaflops de rendimiento. La nueva supercomputadora Horizon estará basada principalmente en servidores PowerEdge de Dell, equipados con GPUs Nvidia con arquitectura Blackwell, y CPU basados en Vera.

Stanzione relató que aunque el sistema comenzó a planearse en 2017 –previo al lanzamiento de ChatGPT–, se debió adaptar a las nuevas demandas de IA dentro de la comunidad científica.

Durante la visita, el directivo del TACC habló también sobre la convergencia entre sistemas de supercómputo (HPC) y AI Factories. Por ejemplo, ciertas tecnologías como la interconexión InfiniBand o alta densidad de racks enfriados por líquido, fueron adoptadas primero por HPC, y ahora son demandadas por proveedores de Nube para sus servicios de IA.

Indicó que aún existen importantes diferencias entre ambas arquitecturas, ya que mientras los sistemas HPC trabajan con una alta precisión de 32 a 64 bits, los sistemas de entrenamiento para IA pueden trabajar con menor precisión (FP16, BF16, FP8), enfocados en maximizar resultados.

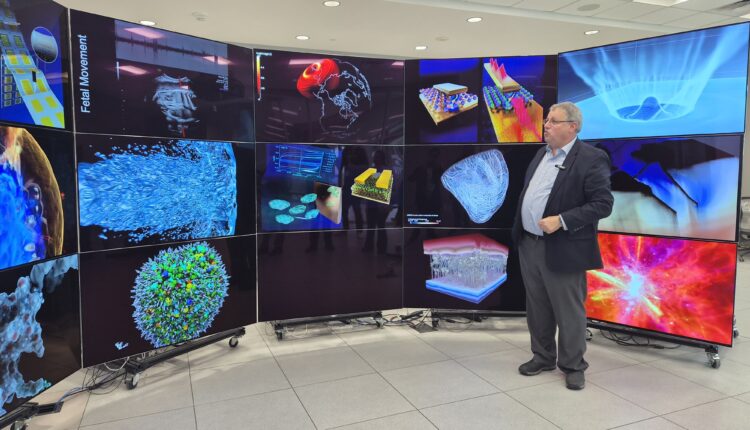

Armando Acosta, AI Product Planner en Dell y quien ha trabajado de cerca con TACC, destacó también las capacidades en HPC de la institución, que demanda la mejor tecnología para atender la investigación en genómica o ciencias de la salud.

“Lo realmente destacable de TACC es que, si bien siguen realizando HPC de manera excepcional, han incorporado también la Inteligencia Artificial a este ámbito. En esencia, lo que hacen ahora es ayudar a sus investigadores a potenciar sus modelos y simulaciones tradicionales de HPC mediante el entrenamiento de modelos basado en IA, lo cual, en la práctica, eleva aún más la calidad de sus investigaciones”, aseguró.

Aplicaciones científicas transformadoras

A pesar de las preocupaciones por el crecimiento acelerado y –hasta el momento– aparentemente sin límites de la infraestructura de IA, Dan Stanzione también apuntó que los supercomputadores están generando avances notables. Desde el TACC se han realizado simulaciones de cosmología que han modelado la evolución del universo desde el Big Bang hasta hoy. Asimismo, modelos de predicción de tsunamis entrenados con 10 millones de horas de GPUs pueden ahora hacer inferencias en un segundo, proporcionando advertencia crítica para ciudades costeras.

Pero también advirtió que el uso correcto y adecuado de los datos es crítico, ya que no todas las aplicaciones pueden basarse en datos sintéticos. Por ejemplo, dosificación de fármacos o diseño de escudos térmicos espaciales requieren de una precisión del 99.999% que sólo un modelo físico puede aportar.

Stanzione espera que haya un crecimiento sostenido mas no explosivo en los próximos años. La industria de IA será enorme, como lo es Internet hoy, pero la volatilidad es inevitable. “Con regulación adecuada podemos construir una industria saludable alrededor de esto. No tiene que ser un desastre ambiental”, afirmó.