En una nueva edición de su evento anual para desarrolladores, Google I/O, el gigante tecnológico mostró todas sus cartas para utilizar la Inteligencia Artificial (IA) como su nuevo motor de crecimiento, al estar incluido en múltiples áreas de la compañía, algunas ya anunciadas como Google Workspace, hasta nuevas características que llegarán a Android.

Después de más de 10 años de inversión en IA, “estamos en los primeros días del cambio de plataforma de la IA. Vemos muchas oportunidades por delante, para los creadores, para los desarrolladores, para las startups, para todos. Ayudar a impulsar esas oportunidades es el objetivo de nuestra era Gemini”, aseguró Sundar Pichai, CEO de Alphabet, durante su presentación.

Pichai inició la conferencia con la presentación de novedades en su modelo principal Gemini. Según el directivo, este modelo ya es utilizado por más de 1.5 millones de desarrolladores en múltiples herramientas de Google: para depurar código, obtener nuevos conocimientos y crear la próxima generación de aplicaciones de IA.

En total, se estima que a través de todos los productos Gemini ya es utilizado por más de 2 mil millones de usuarios, tras su introducción para su uso en móviles, en Workspace, Photos y otros.

A unos meses de haber anunciado el lanzamiento de Gemini 1.5 Pro, Google indica que ha introducido mejoras de calidad en la traducción, la codificación y el razonamiento, las cuales estarán disponibles a partir de hoy. La compañía ahora anunció el lanzamiento mundial de esta versión mejorada para cualquier desarrollador. Además, desde este 14 de mayo, Gemini 1.5 Pro, con un millón de contextos, estará disponible directamente para los consumidores en Gemini Advanced, con capacidad para 35 idiomas.

Sin embargo, Google presentó nuevas pruebas en Gemini con una ventana contextual de 2 millones de tokens, la cual estará a disposición de los desarrolladores en vista previa privada.

Google reveló también que el servicio de búsquedas, que continúa siendo su servicio estrella, recibirá nuevas actualizaciones basadas en IA. Pichai anunció que a partir de esta semana comenzará a ofrecer esta experiencia totalmente renovada, mediante AI Overviews, a todo los usuarios en Estados Unidos, aunque aseguró que “pronto” estaría disponible para más países.

Pregúntale a Fotos

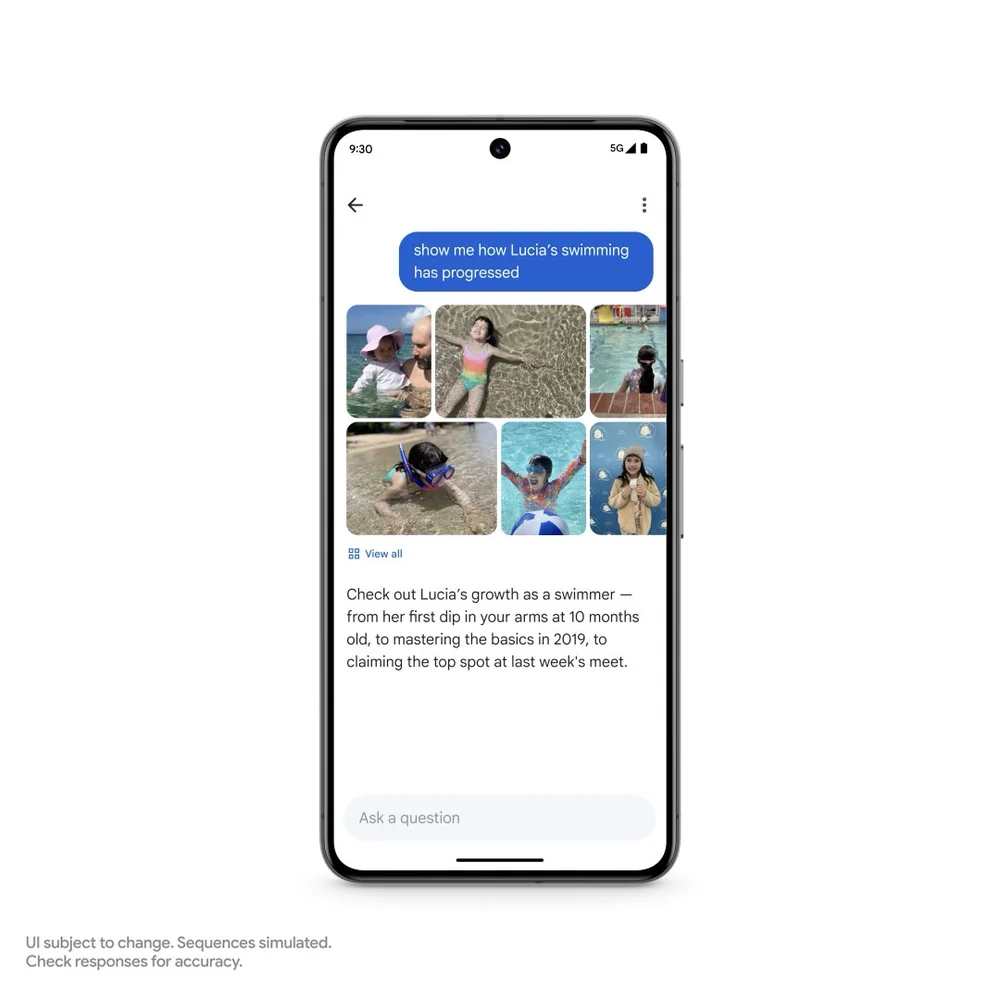

Una de las principales novedades incluye la integración de IA en Google Fotos. Además de permitir la búsqueda de imágenes particulares como un perro o algún color, ahora la plataforma será capaz de responder preguntas más específicas. Por ejemplo, identificar los coches que aparecen a menudo, triangular cuál es el del usuario y dar información como la matrícula.

Esta nueva característica permite incluso responder a preguntas complejas como “¿Cuándo aprendió Lucía a nadar?”, con lo que la aplicación buscará videos relacionados para acceder a estos recuerdos de una forma más sencilla. Según Google, podrá seguir incluso con algo aún más complejo como “Muéstrame cómo ha progresado la natación de Lucía”.

En este caso, Gemini va más allá de una simple búsqueda y reconoce diferentes contextos: desde hacer largos en la piscina hasta bucear en el océano, pasando por el texto y las fechas de sus certificados de natación. Y Fotos lo agrupa todo en un resumen.

Inteligencia Artificial para el trabajo

Durante el pasado Next’24 de Google Cloud, la compañía ya había presentado nuevas funcionalidades que se sumarían a Workspace, como un asistente para la redacción de correos electrónicos o para ayudar a resumir reuniones en Google Meet.

Entre las nuevas funcionalidades anunciadas en el evento para desarrolladores, Pichai reveló que ahora Gemini permitirá resumir todos los correos electrónicos recientes. Por ejemplo, se le puede pedir un resumen de correos en la escuela, con lo que la IA podrá identificar los correos relevantes e incluso analizar los archivos adjuntos, como PDFs. Como resultado, ofrece un resumen de los puntos clave y los elementos de acción.

Adicionalmente, podrá ofrecer resúmenes de reuniones en Google Meet, aun cuando el usuario no haya podido atender a la convocatoria.

También lee: OpenAI lanza GPT-4o, su nuevo modelo de IA que permite conversar en tiempo real con ChatGPT

Nuevas funcionalidades llegarán también a Docs y Gmail en la forma de AI Teammate, impulsado por Gemini. Este asistente funcionará como un compañero de productividad, que podrá recibir un nombre elegido por el usuario, y ayudará en diversas tareas como coordinar mejor las comunicaciones entre compañeros de trabajo, realizar un seguimiento de los archivos de un proyecto, confeccionar listas de tareas pendientes y hacer un seguimiento de las asignaciones.

Google también adelantó una demostración de Gems, una nueva función que establece rutinas automatizadas para las cosas que uno quiere que Gemini haga regularmente. Se puede configurar para que gestione varias tareas digitales y ejecutarlas con una orden de voz o un mensaje de texto. Google llama a cada una de esas rutinas “Gems”.

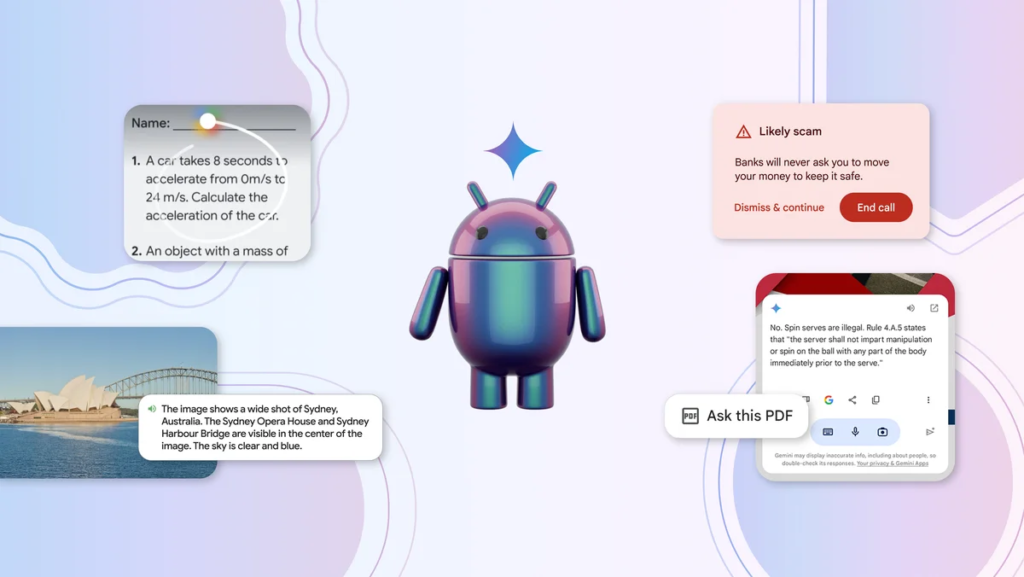

Por otro lado, la función Circle To Search, que debutó a principios de este año en algunos dispositivos como los Samsung Galaxy, recibirá pronto una actualización, que permitirá ayudar a los estudiantes con las tareas escolares, como ofrecer detalles para resolver problemas de matemáticas.

Agentes de IA

Como también ya había sido adelantado en el evento de Google Cloud, la compañía buscará impulsar el uso de IA mediante la introducción de los llamados Agentes, que básicamente es una solución que debería facilitar la automatización de tareas y el uso práctico de las capacidades de una IA.

“En mi opinión, son sistemas inteligentes que demuestran razonamiento, planificación y memoria. Son capaces de ‘pensar’ varios pasos por delante y de trabajar con distintos programas y sistemas, todo ello para hacer algo en su nombre y, lo que es más importante, bajo su supervisión”, aseguró Pichai.

Entre algunos casos de uso que la compañía adelantó para estos Agentes, se encuentran gestionar la devolución de un producto, desde localizar el recibo de compra, llenar el formulario de devolución, hasta programar el día de recogida por una empresa de logística como UPS.

Otro ejemplo presentado por el directivo, se trata de un usuario que recién se mudó a una nueva ciudad. Un Agente podría tener la capacidad de ofrecer servicios similares a los que se tenían en la ciudad anterior, como una tintorería o un veterinario, y actualizar los datos requeridos como nombres y direcciones. Pichai destacó que el Agente podrá siempre pedir o corroborar información al usuario para mantener su uso “privado, seguro y útil para todos”.

Un modelo más ligero y accesible

Por otro lado, Pichai habló sobre la oferta de opciones de modelos de IA para los desarrolladores. Aunque Gemini 1.5 Pro sería su modelo más poderoso y con más características hasta el momento, la compañía reconoció que la comunidad de desarrolladores pedía algo más ligero y costo efectivo.

Como parte de esto, Google adelantó la presentación de Gemini 1.5 Flash, un modelo más ligero diseñado para escalar. Está optimizado para tareas en las que la baja latencia y el coste son lo más importante. 1.5 Flash estará disponible en AI Studio y Vertex AI.

Adicionalmente, la compañía presentó los avances de su Proyecto Astra, la visión de Google DeepMind sobre un futuro asistente impulsado con una mejor comprensión multimodal y capacidades conversacionales en tiempo real.

Astra utiliza el video capturado con un teléfono y el reconocimiento de voz para ofrecer respuestas contextuales a diversas preguntas. La demo presentada en el evento incluía alguien utilizando Project Astra para ayudarle a resolver un problema de codificación utilizando una cámara, al tiempo que localizaba dónde había dejado sus gafas o identificar objetos que emitieran algún tipo de ruido.

Pichai habló también sobre avances en la generación de video e imágenes con Veo e Imagen 3, y la presentación de Gemma 2.0, la próxima generación de modelos abiertos para la innovación responsable de la IA.

Infraestructura para la era de la IA

Pichai presentó también el desarrollo de nueva infraestructura y chips para atender las demandantes cargas de trabajo de IA, que se basan en el trabajo de la compañía sobre procesadores Tensor.

Durante el evento, Google mostró la sexta generación de TPU, llamada Trillium. El directivo aseguró que se trata del procesador “más eficiente y de mayor rendimiento hasta la fecha, ya que multiplica por 4.7 el rendimiento computacional por chip de la generación anterior, la TPU v5e”. Trillium estará a disposición de los clientes de Cloud a finales de 2024.

También lee: Google Cloud ve la IA como clave para mantener rentabilidad

Asimismo, anunció la disposición de mayor infraestructura basada en CPUs y GPUs, incluyendo los nuevos procesadores Axion presentados el mes pasado, que se trata de la primera CPU personalizada de Google basada en Arm, enfocada en un mayor rendimiento con un menor consumo energético.

Por otro lado, adelantó que Google Cloud será uno de los primeros hyperscalers en ofrecer la más reciente línea de GPUs Blackwell de Nvidia, disponibles a principios de 2025.

Gemini en Android

Otra de las principales novedades presentadas por Google incluye la introducción de Gemini Nano, un nuevo asistente de Inteligencia Artificial que estará disponible para dispositivos móviles Android. Entre sus principales características es que contará con multimodalidad para procesar texto, imágenes, audio y voz para desbloquear nuevas experiencias mientras mantiene la información privada en el dispositivo.

Por ejemplo, Google utilizó el modelo para escanear todos los libros almacenados en un estante y crear una base de datos con la información.