Microsoft mejora capacidades de investigación de Copilot para crear borradores y hacer revisión

Researcher, el agente de investigación profunda de Microsoft 365 Copilot, recibió nuevas capacidades multimodelo para ayudar en el flujo de trabajo de investigaciones complejas, lo que permite elevar su nivel de precisión, profundidad y confianza: Crítica (Critique) y Consejo (Council).

Según explica la compañía en una entrada de blog, Critique es un nuevo sistema de investigación profunda multimodelo diseñado para tareas de investigación complejas. La principal característica de este sistema es que separa la generación de la evaluación, a la vez que permite combinar modelos de los laboratorios Frontier, incluidos Anthropic y OpenAI.

Un modelo lidera la fase de generación, planificando la tarea, iterando a través de la recuperación y produciendo un borrador inicial, mientras que un segundo modelo se centra en la revisión y el refinamiento, actuando como un revisor experto antes de que se produzca el informe final. Microsoft afirma que esta arquitectura supera los enfoques tradicionales de modelo único y ofrece la mejor calidad de investigación profunda de su clase.

A diferencia del enfoque tradicional basado en un modelo único, Critique divide las responsabilidades entre dos socios de IA: uno optimizado para la exploración profunda y la síntesis estructurada, y un segundo centrado en validar afirmaciones, mejorar la presentación y fortalecer la estructura.

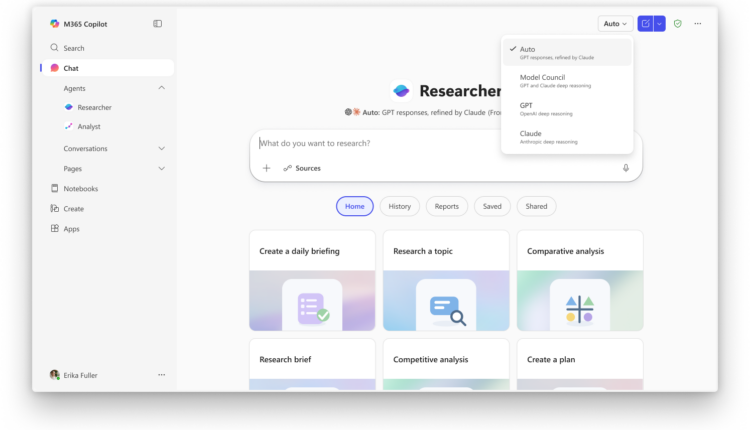

Critique será la experiencia predeterminada en Researcher, disponible cuando se elige Auto en el selector de modelos.

Council, por su parte, ejecuta un modelo Anthropic y OpenAI simultáneamente, y cada modelo produce un informe completo e independiente —que presenta hechos, citas y marcos analíticos que el otro puede pasar por alto o sopesar de manera diferente.

Una vez generados ambos informes, un modelo de juez dedicado los evalúa para crear un resumen destilado de los hallazgos clave y destaca dónde los modelos concuerdan o divergen significativamente, incluidas las diferencias en magnitud, encuadre o interpretación, y destaca las contribuciones únicas de cada modelo.

Microsoft espera que estas funcionalidades mejoren las capacidades de Researcher para entornos de investigación académicos y profesionales al seguir un proceso de revisión similar. La funcionalidad de Critique se basa en evaluación basada en rúbricas, una revisión estructurada que se centra en fortalecer el informe sin convertir al revisor en un segundo autor.

El revisor se concentra en las siguientes dimensiones: evaluación de confiabilidad de la fuente, informe completitud; y aplicación estricta de la fundamentación de pruebas.

Microsoft detalla que realizó una evaluación de Critique en el punto de referencia DRACO (precisión, integridad y objetividad de la investigación profunda), lo que incluye 100 tareas complejas de investigación profunda en 10 dominios, introducidas por investigadores de Perplexity y el mundo académico en febrero de 2026. Los resultados de DRACO se evaluaron utilizando GPT-5.2 de OpenAI como juez LLM.

En comparación con el enfoque de modelo único, la compañía apunta que las mejoras se encontraron en amplitud y profundidad del análisis (+3.33), seguida de la calidad de la presentación (+3.04) y la precisión fáctica (+2.58). Todas las dimensiones muestran mejoras estadísticamente significativas.