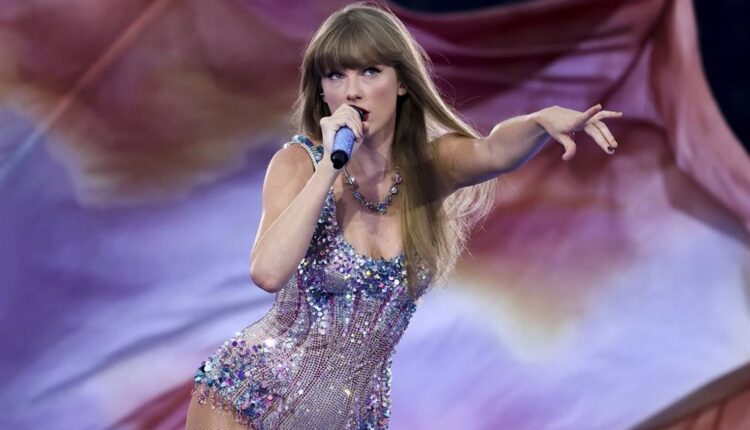

Swifties salvaguardan a Taylor Swift en X tras deepfakes de la cantante

Luego de que se difundieran imágenes falsas de Taylor Swift desnuda creadas con Inteligencia Artificial, la red social X ha tomado medidas temporales para suspender las búsquedas relacionadas con la cantante. El caso enciende las alarmas sobre los peligros de la IA para las mujeres.

Las búsquedas relacionadas con la cantante estadounidense Taylor Swift en la red social X (anteriormente conocida como Twitter) han sido temporalmente suspendidas.

Este cambio se produce después de varios días en los que el tema “Taylor Swift AI” se volvió tendencia en la red, debido a que se compartieron imágenes falsas de la cantante en posiciones sugerentes y de carácter sexual generadas mediante Inteligencia Artificial (IA).

Joe Benarroch, jefe de operaciones comerciales de X, confirmó la suspensión de las búsquedas a The Wall Street Journal, destacando que esta medida se implementa con cautela y priorizando la seguridad.

Al intentar buscar “Taylor Swift” en el motor de búsqueda de X, aparece el siguiente mensaje: “Las publicaciones no están cargando en este momento. Inténtelo más tarde”.

La decisión de suspender las búsquedas se anunció después de que imágenes falsas de Taylor Swift desnuda se volvieran virales en la red. Según informes de 404 Media, estas fueron creadas utilizando un modelo generador de IA gratuito de Microsoft.

En respuesta a la difusión de estas imágenes, los fanáticos de Swift tomaron medidas para defender a la artista. Reportaron las cuentas que compartieron el contenido falso y generaron una avalancha de publicaciones auténticas relacionadas con la cantante para contrarrestar las falsificaciones.

Ante la presión de los “swifties”, la red social emitió un comunicado recordando su política de tolerancia cero hacia la publicación de imágenes de desnudos no consensuadas. Aseguraron que están eliminando activamente todas las imágenes identificadas y tomando medidas apropiadas contra las cuentas responsables.

Sin embargo, la falta de respuesta inmediata por parte de X, propiedad de Elon Musk, ha generado críticas. Una de las imágenes alteradas de Taylor Swift fue vista 47 millones de veces y recibió miles de “me gusta” antes de ser eliminada de la plataforma.

El caso Swift aviva el debate por los riesgos de la IA para las mujeres

Esta controversia ha avivado el debate en el sector tecnológico sobre los riesgos asociados con el avance de la Inteligencia Artificial Generativa sin supervisión. Entre sus muchas aplicaciones, esta tecnología es utilizada para crear falsificaciones profundas o deepfakes, permitiendo que cada vez sea más fácil crear pornografía digital falsa de cualquier persona.

El problema de la pornografía falsa generada por IA ha experimentado un aumento notable en los últimos años, afectando de manera desproporcionada a las mujeres. Este tipo de violencia digital ha impactado no sólo a figuras famosas como la cantante Rosalía el año pasado, sino también a mujeres jóvenes y niñas comunes.

La proliferación de sitios dedicados a desnudar mujeres con IA y la distribución de este contenido a través de plataformas como Telegram, X, Reddit y 4Chan es alarmante.

Dada la relevancia de Swift, el caso ha llamado la atención en la Casa Blanca. La secretaria de prensa, Karine Jean-Pierre, afirmó en una conferencia que, aunque las empresas de redes sociales tienen la responsabilidad de prevenir la distribución de imágenes falsas, el gobierno de Estados Unidos está comprometido a tomar acciones ejecutivas para reducir el riesgo que enfrentan mujeres y niñas con esta tecnología.